- pub

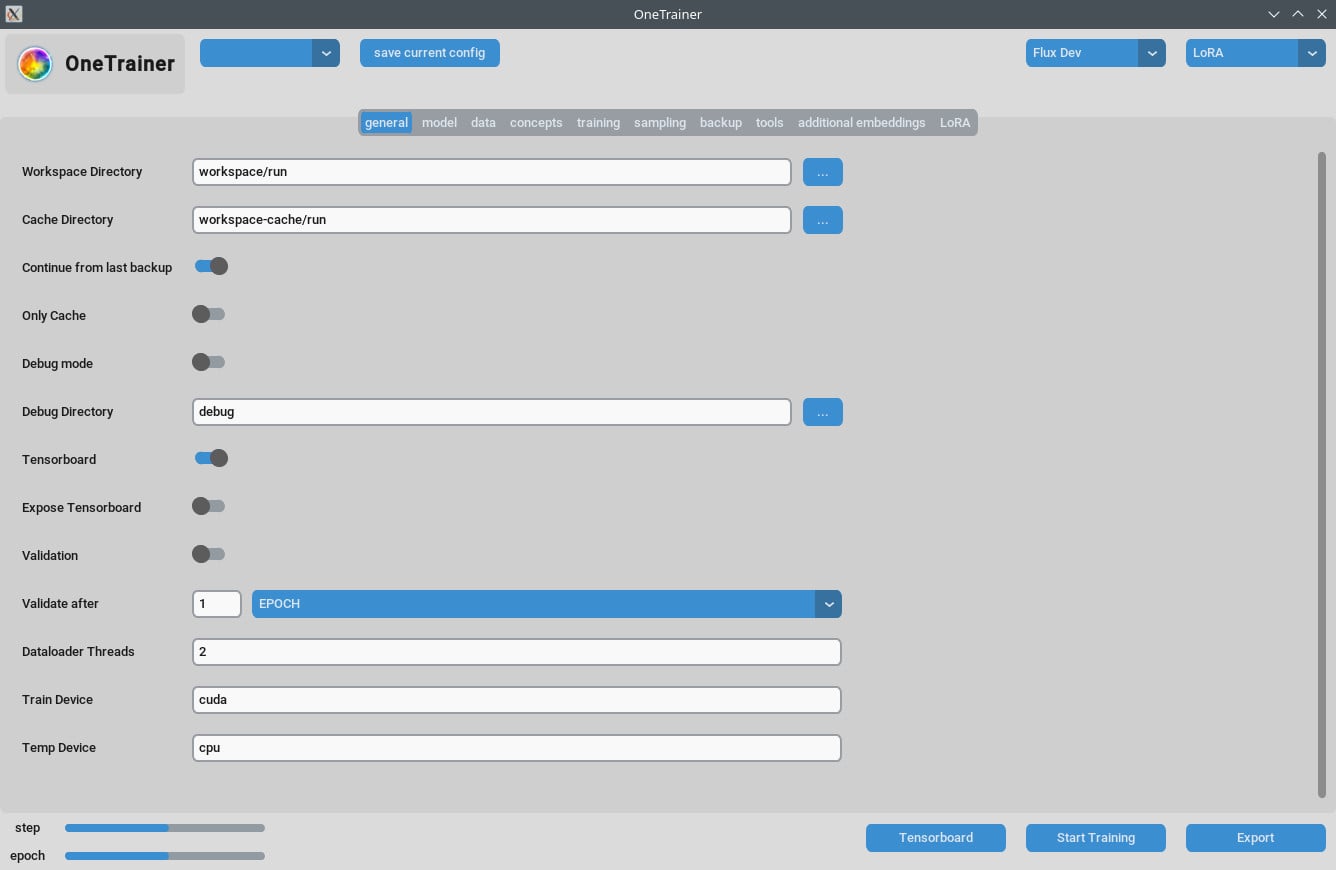

Оптимизированные настройки OneTrainer и советы для обучения Flux.1 LoRA и DoRA (на 20% быстрее)

Подготовка к обучению

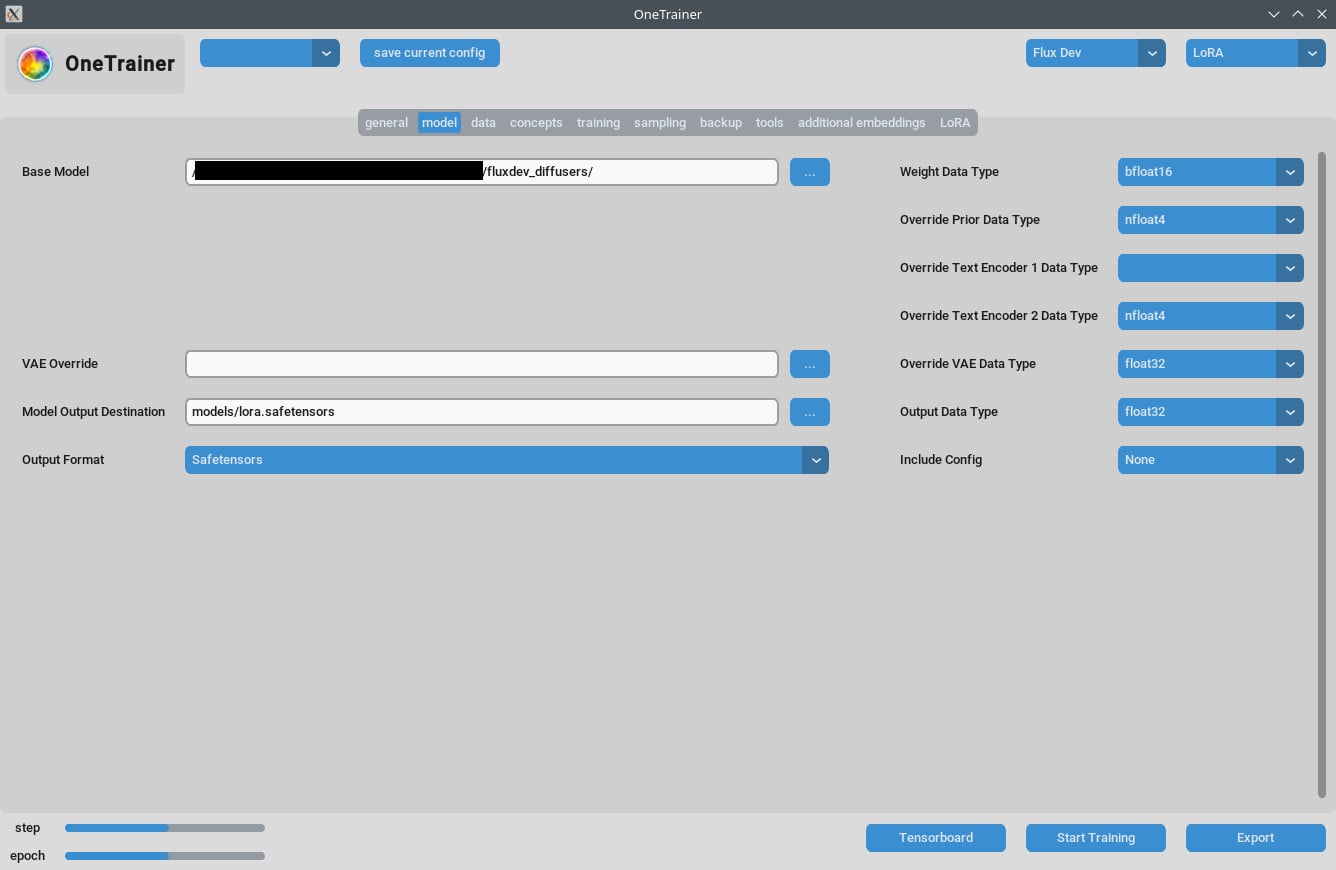

Выбор модели

Сначала проверь, что ты выбрал правильную модель Flux AI. OneTrainer поддерживает разные модели, такие как Flux.1 dev, pro и schnell. Убедись, что модель подходит для твоего проекта.

- Получение модели: Скачай нужную модель с официальных источников, таких как Hugging Face.

- Загрузка модели: В OneTrainer перейди в настройки модели и загрузите файлы модели.

Настройка окружения

Требования к железу:

- GPU: Лучше минимум 3060. Если повезёт с 4090, будет еще лучше.

- VRAM: Как минимум 12 ГБ, чтобы работать с более высокими разрешениями.

- RAM: Рекомендуется не меньше 10 ГБ, чем больше, тем лучше.

Требования к софту:

- ОС: Проверено на Windows и Linux.

- Зависимости: Убедись, что все зависимости установлены. Загляни в документацию OneTrainer для списка необходимых библиотек и инструментов.

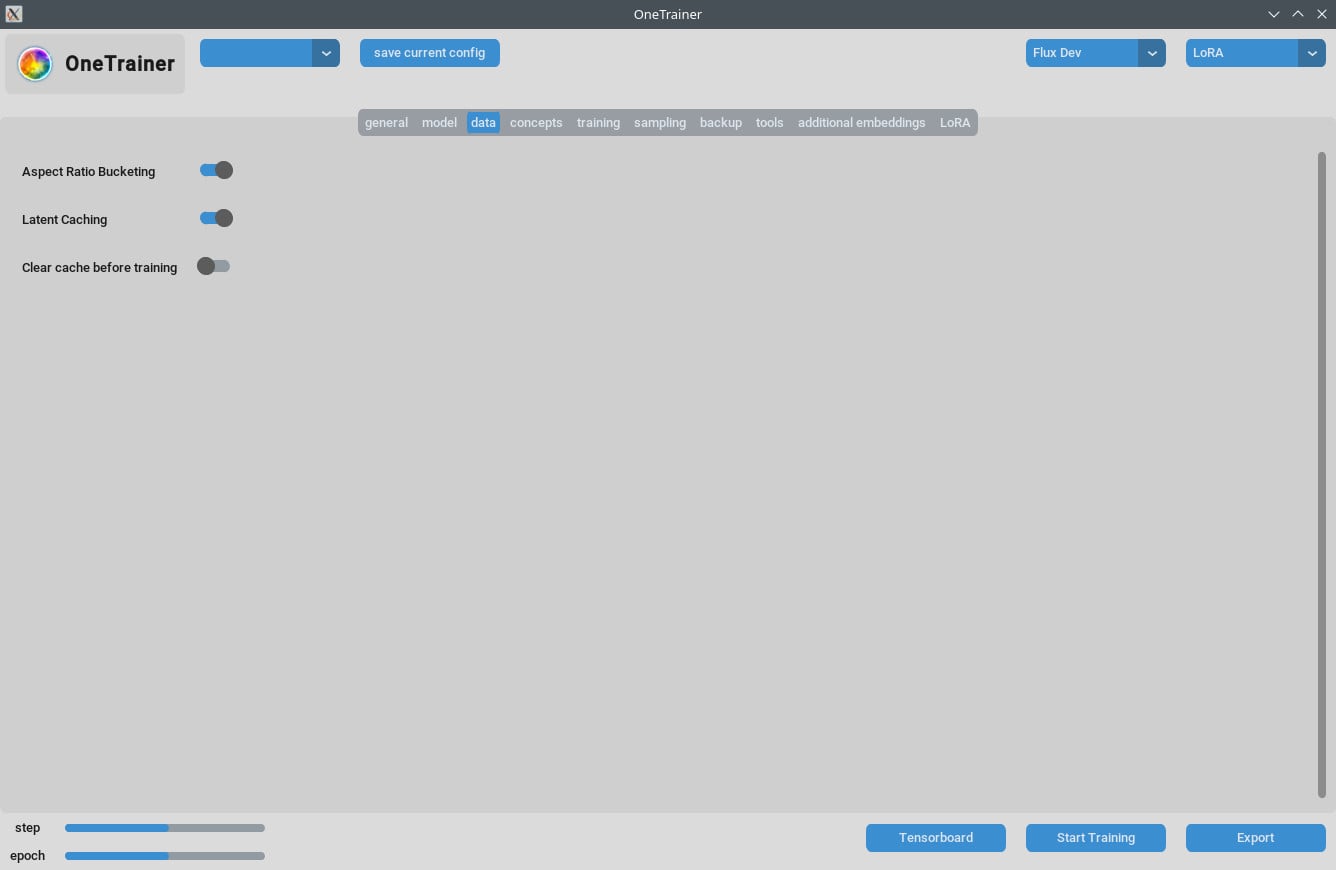

Подробные настройки и конфигурации

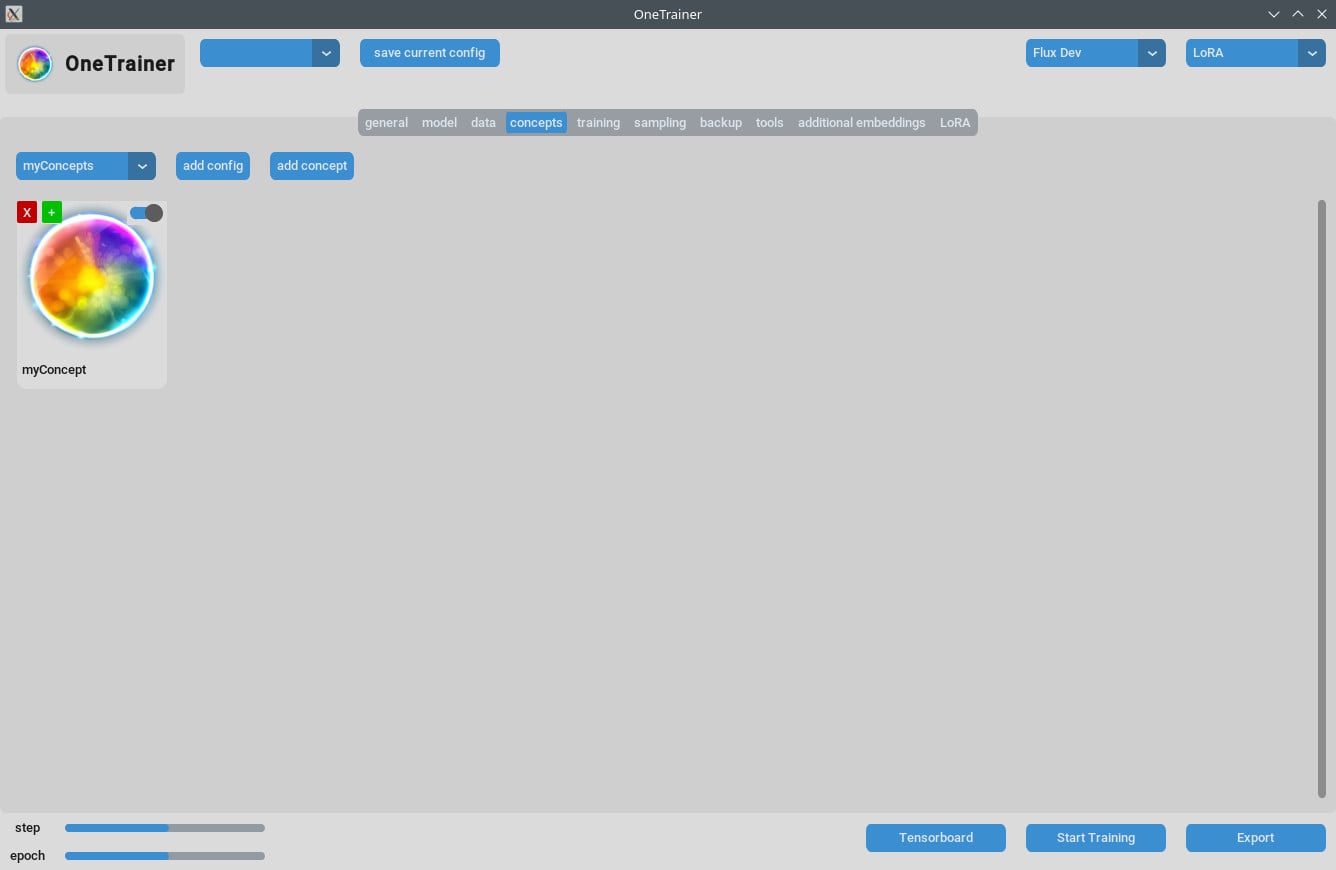

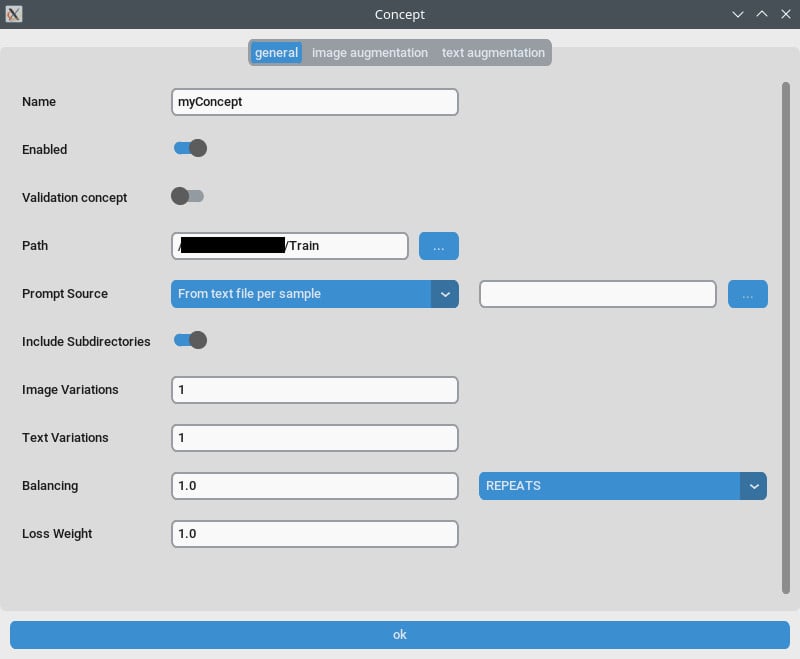

Вкладка Концепт/Общие настройки

- Повторы: Установи

Повторына 1. Управляй количеством повторов черезКоличество эпохна вкладке обучения. - Источник подсказок: Используй "из одного текстового файла", если хочешь "триггерное слово", а не отдельные подписи для каждого изображения. Укажи путь к текстовому файлу с триггерным словом/фразой.

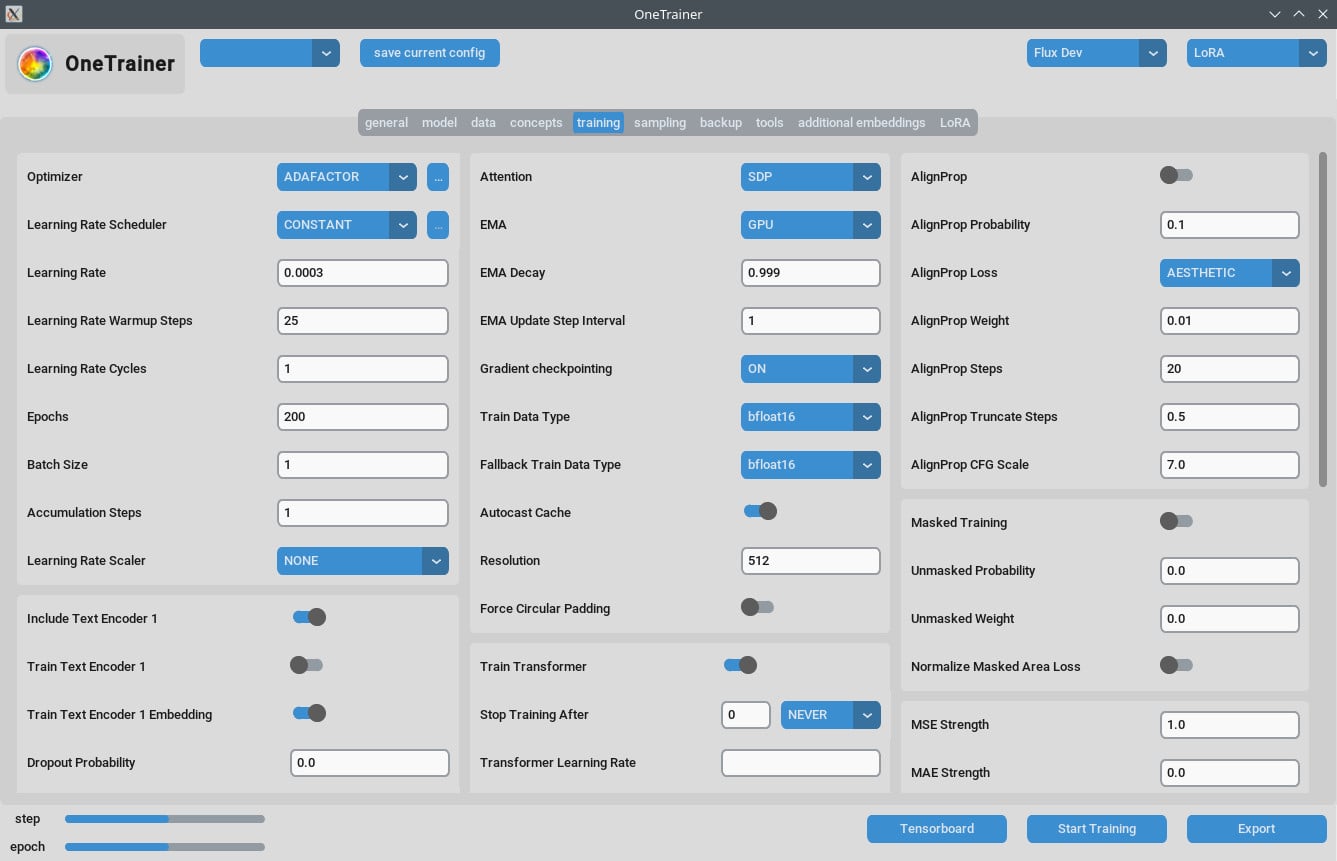

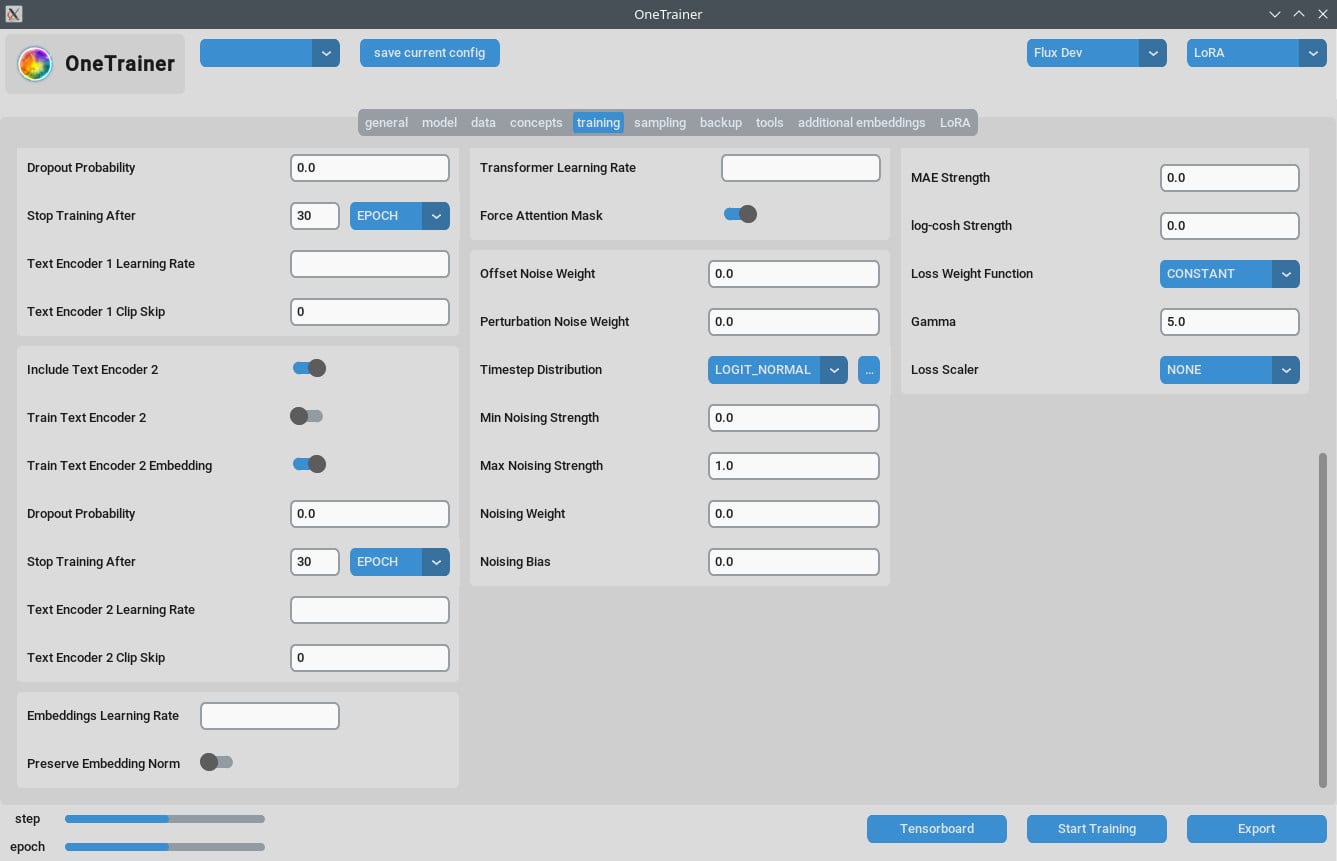

Вкладка Обучение

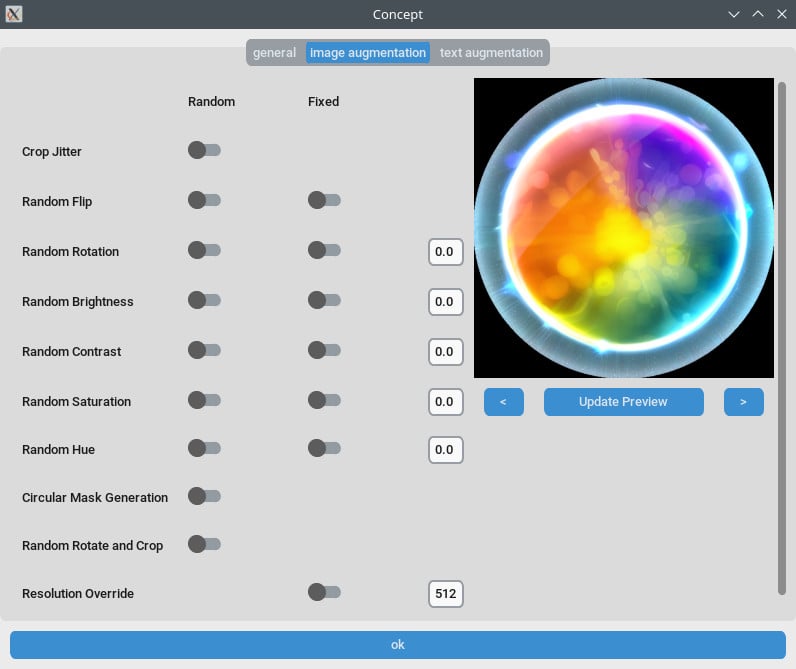

Настройки разрешения

- Для лучшего качества:

- Установи

Разрешениена 768 или 1024 для более качественных выходов.

- Установи

- Настройки EMA:

- EMA: Используй во время тренировок SDXL.

- EMA GPU: Чтобы сэкономить VRAM, переключи EMA с "GPU" на "OFF".

- Скорость обучения:

- Начни с 0.0003 или 0.0004. Подкорректируй по своим нуждам.

- Количество эпох:

- Обычно 40 эпох дают хорошие результаты. Подстраивай в зависимости от сложности твоего датасета.

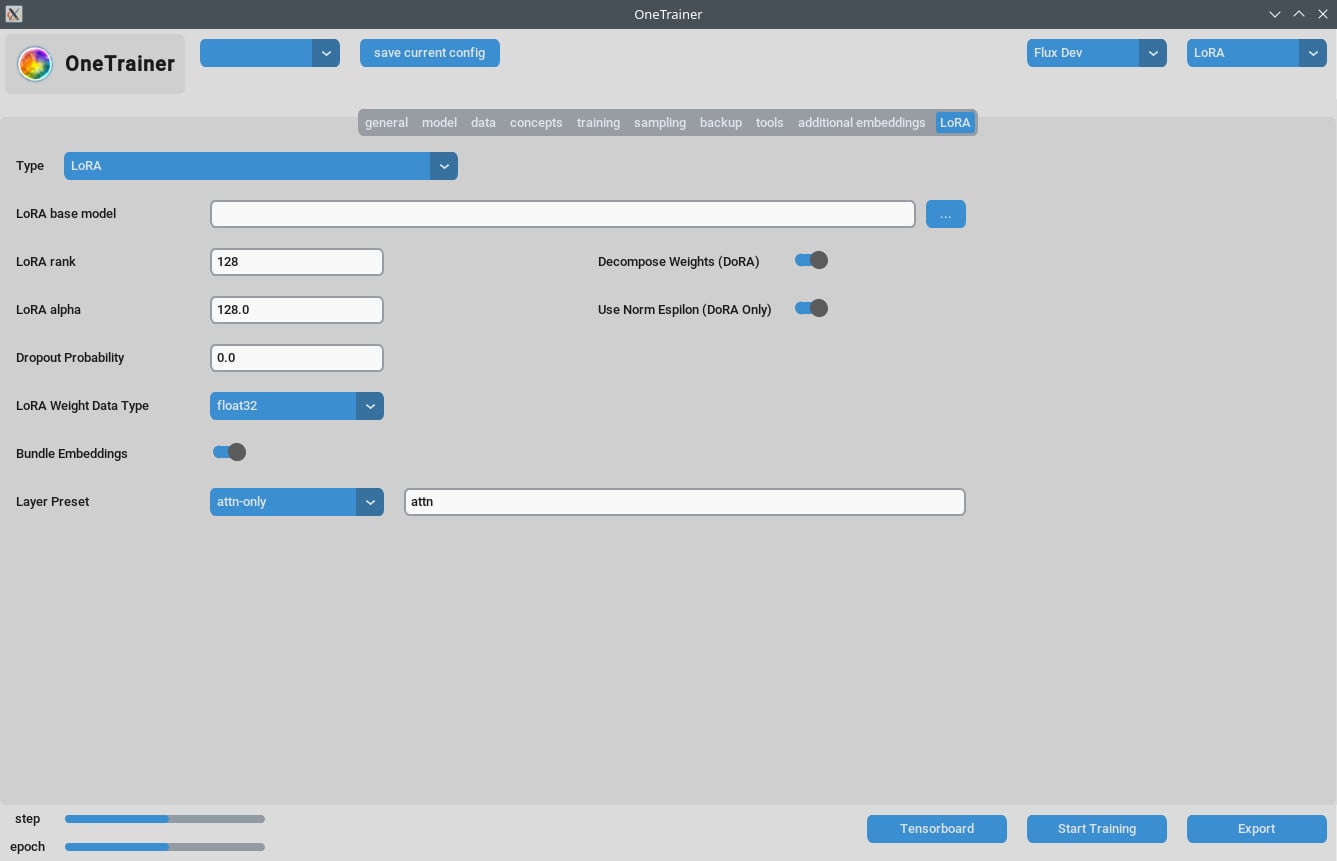

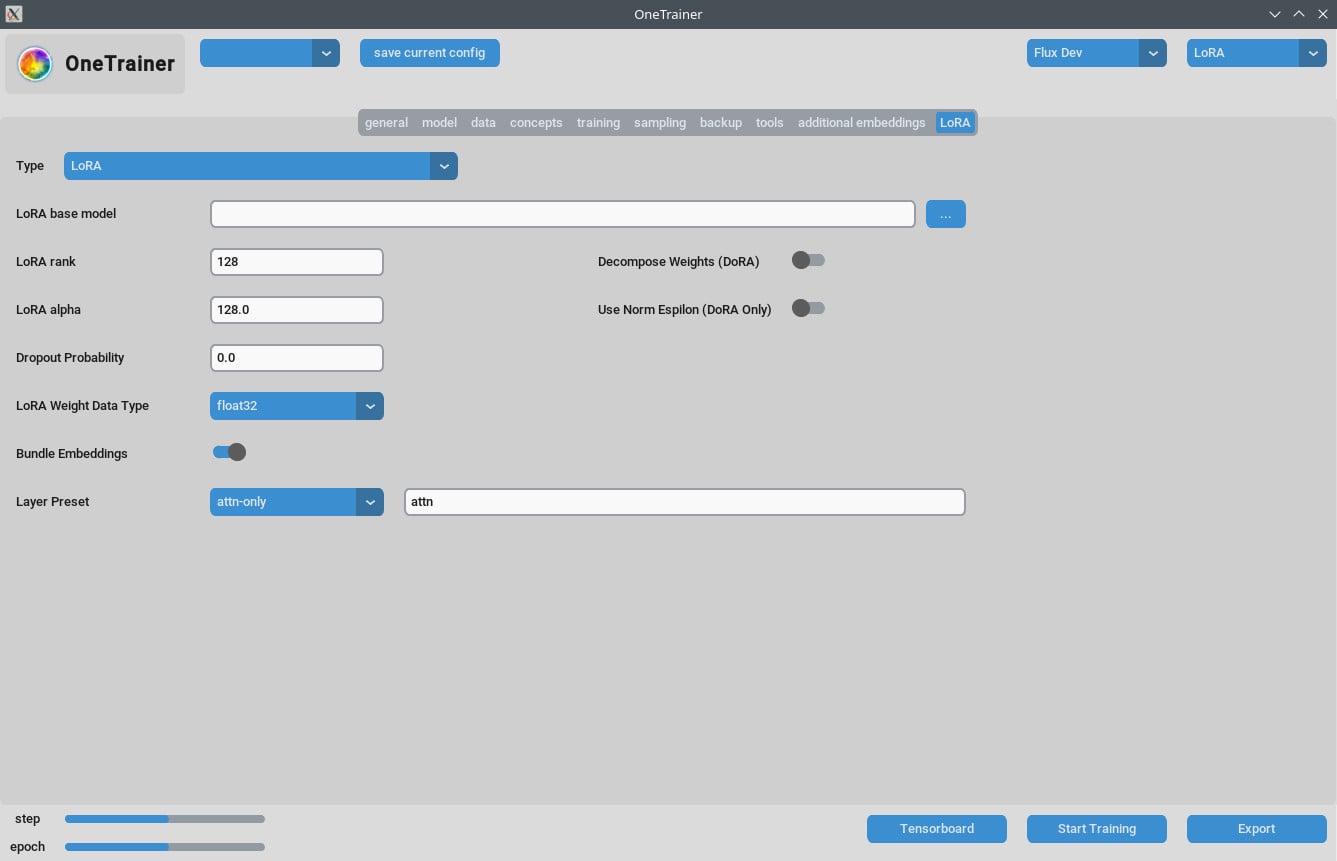

Вкладка LoRA

- Ранг и Альфа:

- Держи эти значения одинаковыми (например, 64/64, 32/32) или настрой скорость обучения соответственно.

- Результирующие LoRA модели:

- Убедись, что обновления применяются, если используешь последние версии ComfyUI.

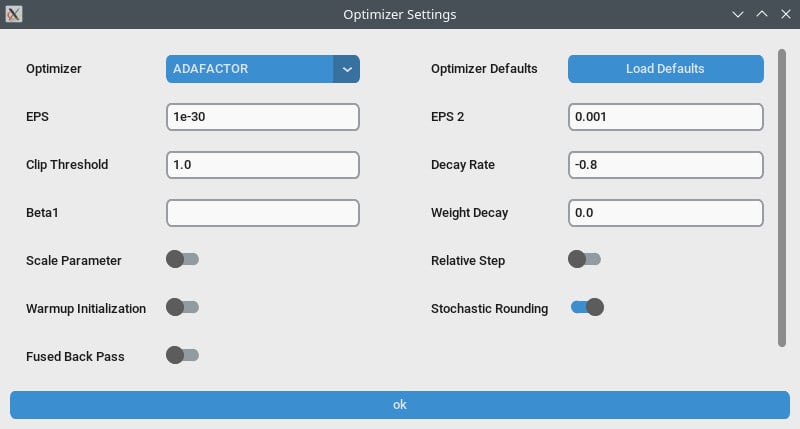

Оптимизация производительности

- Контроль градиентов:

- Попробуй отключить это, если скорость не устраивает, особенно если железо поддерживает больше VRAM.

- bf16 против nfloat4:

- В вкладке "модель" поменяй

Переопределить предыдущее значение типа данныхна bf16, чтобы, возможно, повысить качество. Эта настройка влияет на VRAM и скорость.

- В вкладке "модель" поменяй

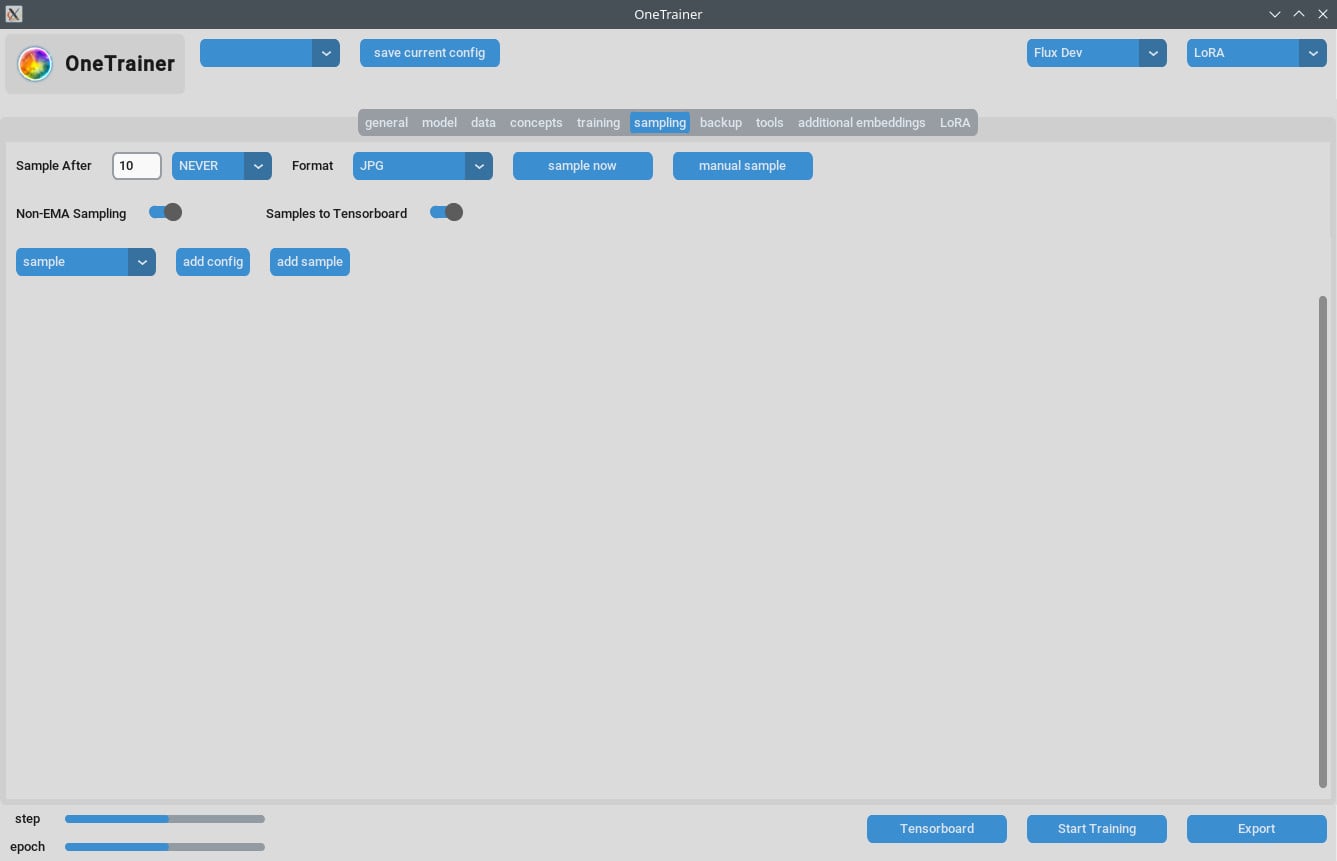

Обработка проблем с выборкой

- Некоторые пользователи сталкивались с ошибкой Out Of Memory (OOM) во время выборки. Убедись, что у твоего GPU достаточно VRAM.

- Регулярно обновляй OneTrainer, чтобы получать исправления ошибок и патчи.

Советы по многоконцептному обучению

Текущие ограничения

- Обучение нескольких людей с разными триггерными словами за одну сессию часто не срабатывает.

- Разные объекты или ситуации (например, тренировочные кроссовки и конкретные машины) работают лучше.

Лучшие практики

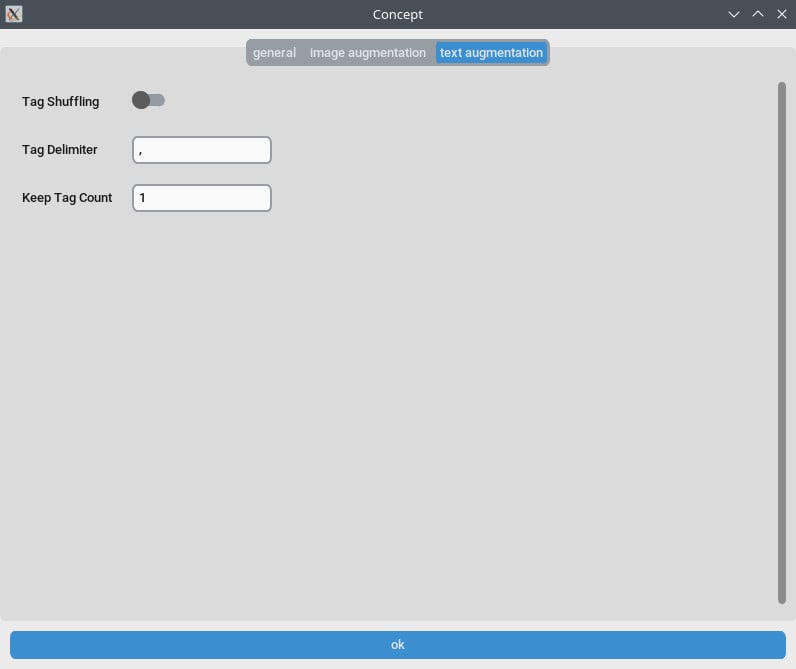

- Короткие подписи:

- Используй короткие, естественные подписи. Они работают хорошо всего за несколько сотен шагов.

- Накопление LoRA:

- Накопление концепции и персонажа LoRA дает лучшие результаты, чем совместное обучение.

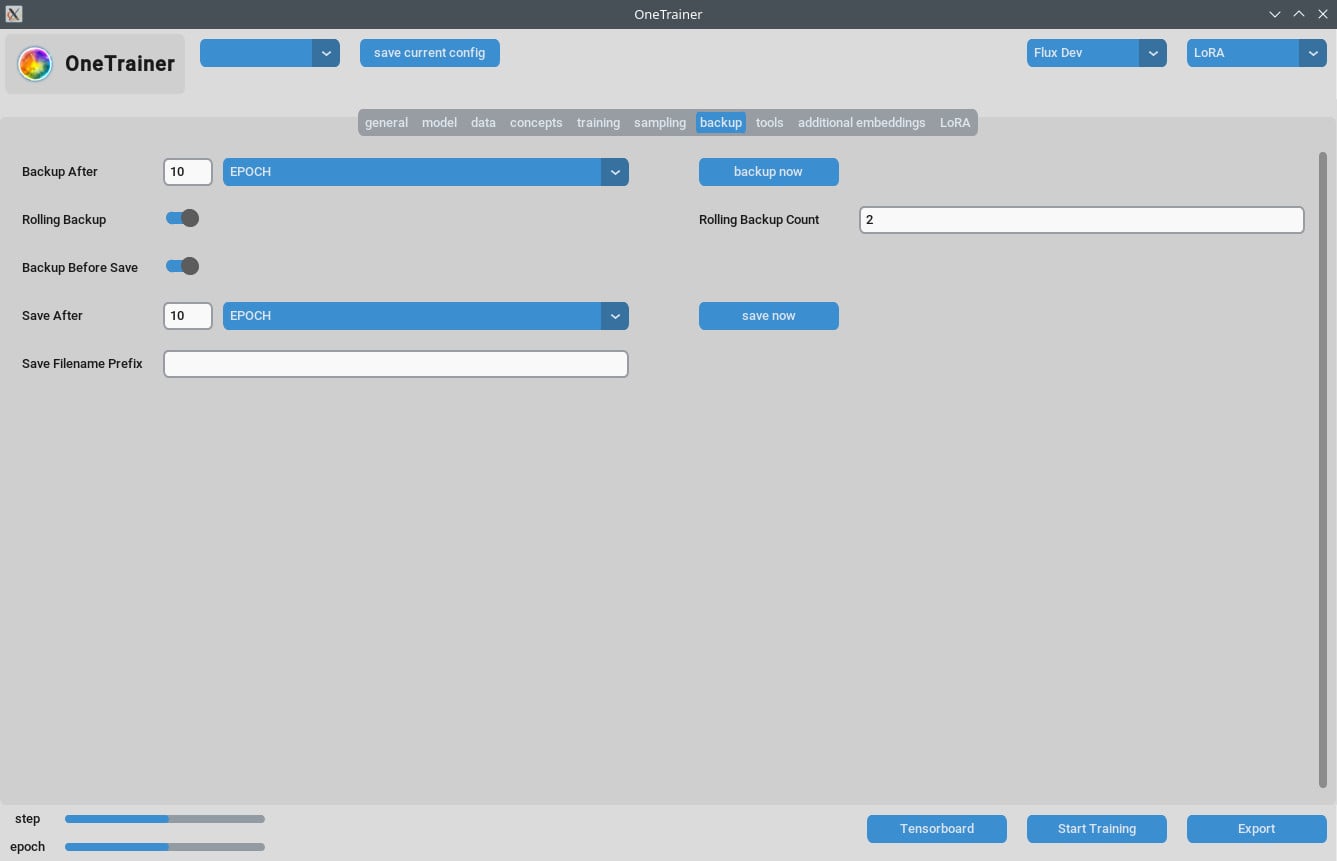

Подписи и управление данными

- Упорядочь свои данные для обучения аккуратно. Количество эпох зависит от сложности данных.

- Короткие, точные подписи могут значительно поднять эффективность обучения.

Часто задаваемые вопросы

В1: Могу ли я использовать OneTrainer для моделей, отличных от Flux.1?

Да, OneTrainer поддерживает SD 1.5, SDXL и другие. Настройки будут различаться в зависимости от модели.

В2: OneTrainer автоматически использует название концепции как триггерное слово?

Да, название концепции может выступать в роли триггерного слова. Главное, чтобы оно имело смысл для твоего проекта.

В3: Как управлять VRAM эффективно во время обучения?

Установи Контроль градиентов на CPU_OFFLOAD. Эта настройка помогает снизить использование VRAM без значительного влияния на скорость.

В4: Какое влияние оказывает использование NF4 против полных точечных слоев?

NF4 уменьшает использование VRAM, но может немного снизить качество. Полные точечные слои сохраняют качество, но требуют больше VRAM.

В5: Как уменьшить размер своей модели LoRA?

Ты можешь уменьшить значения Ранга и Альфа или установить Тип данных веса LoRA на bfloat16. Это уменьшит размер, но может повлиять на качество.

В6: Может ли OneTrainer поддерживать многорезолюционное обучение?

Да, OneTrainer поддерживает многорезолюционное обучение. Следуй инструкциям в вики OneTrainer для настройки.

В7: Мои изображения выглядят как розовая статика при использовании DoRA. Что делать?

Проверь настройки слоя внимания. Избегай использования "full" для слоев внимания, так как это может вызывать проблемы.

В8: Как работать с несколькими объектами в OneTrainer?

Используй сбалансированное обучение, устанавливая разные значения повторов для разных объектов. Аккуратно организуй данные, чтобы оба объекта получили равное обучение.

В9: Есть ли эквивалент 'режима разделения' в OneTrainer?

В OneTrainer нет 'режима разделения'. Вместо этого используй такие настройки, как CPU_OFFLOAD для Контроля градиентов, чтобы эффективнее управлять VRAM.

В10: Можно ли настраивать параметры OneTrainer для лучшего качества с большим использованием VRAM?

Да, увеличь разрешение и подстрои типы данных и настройки контроля градиентов для повышения качества.

Этот гайд должен покрыть все необходимые шаги, настройки и советы по устранению проблем для эффективного использования OneTrainer с моделями Flux AI. Удачи в обучении!