- pub

Configuraciones y Consejos Optimizados de OneTrainer para Entrenamiento de Flux.1 LoRA y DoRA (20% Más Rápido)

Preparándose para el Entrenamiento

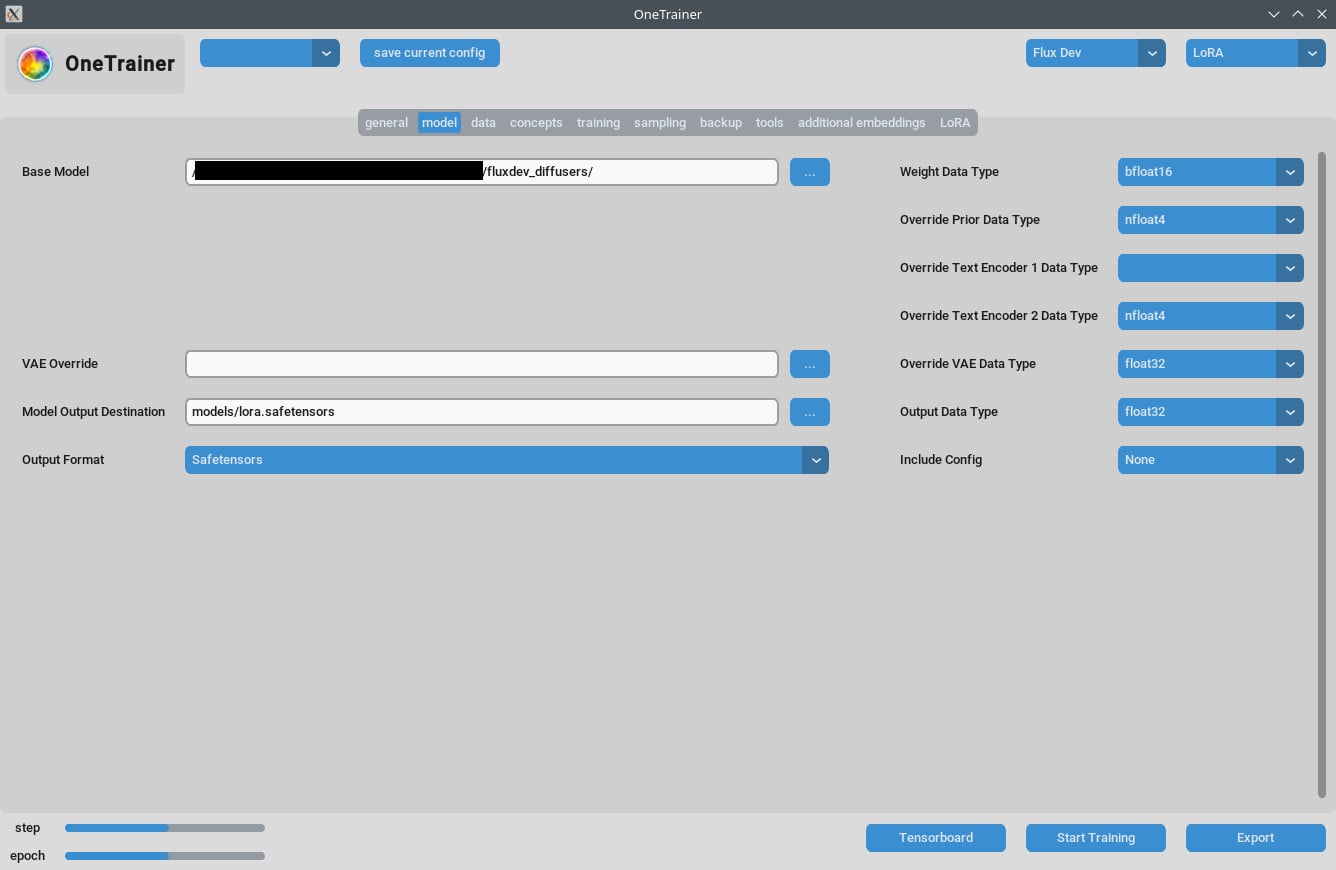

Seleccionando el Modelo

Primero, asegúrate de haber elegido el modelo correcto, el Flux AI. OneTrainer soporta varios modelos, incluyendo Flux.1 dev, pro y schnell. Usa uno que se ajuste a tu proyecto.

- Consigue el Modelo: Descarga el modelo que quieres de fuentes oficiales, como Hugging Face.

- Carga el Modelo: En OneTrainer, ve a la configuración del modelo y carga los archivos del modelo.

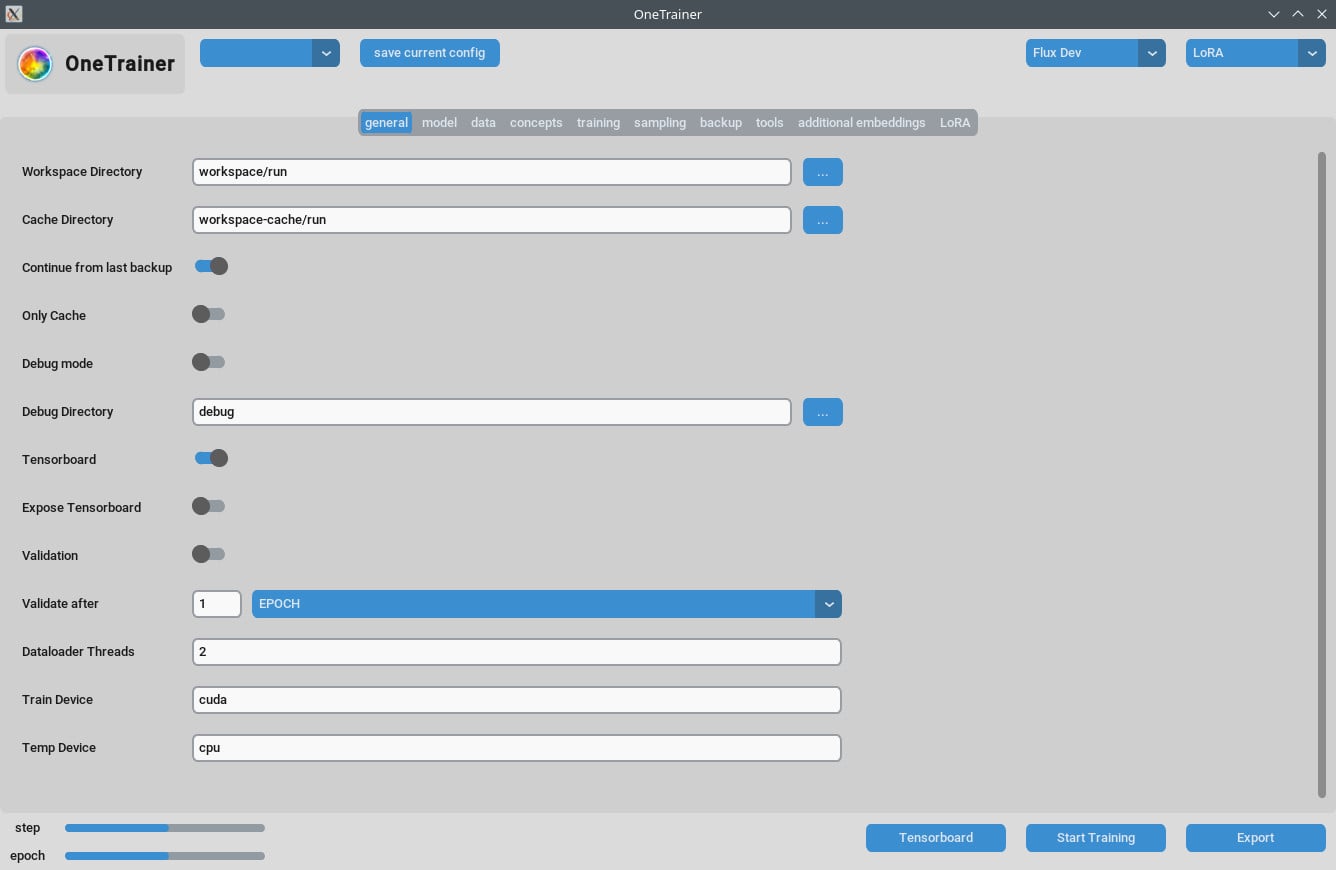

Configurando el Entorno

Requisitos de Hardware:

- GPU: Se recomienda al menos una 3060. Una 4090 da un mejor rendimiento.

- VRAM: Necesitas al menos 12 GB para manejar resoluciones más altas.

- RAM: Lo ideal es tener un mínimo de 10 GB, y si es más, mejor.

Requisitos de Software:

- Sistema Operativo: Probado tanto en Windows como en Linux.

- Dependencias: Asegúrate de tener todas las dependencias instaladas. Revisa la documentación de OneTrainer para ver qué bibliotecas y herramientas necesitas.

Configuraciones Detalladas

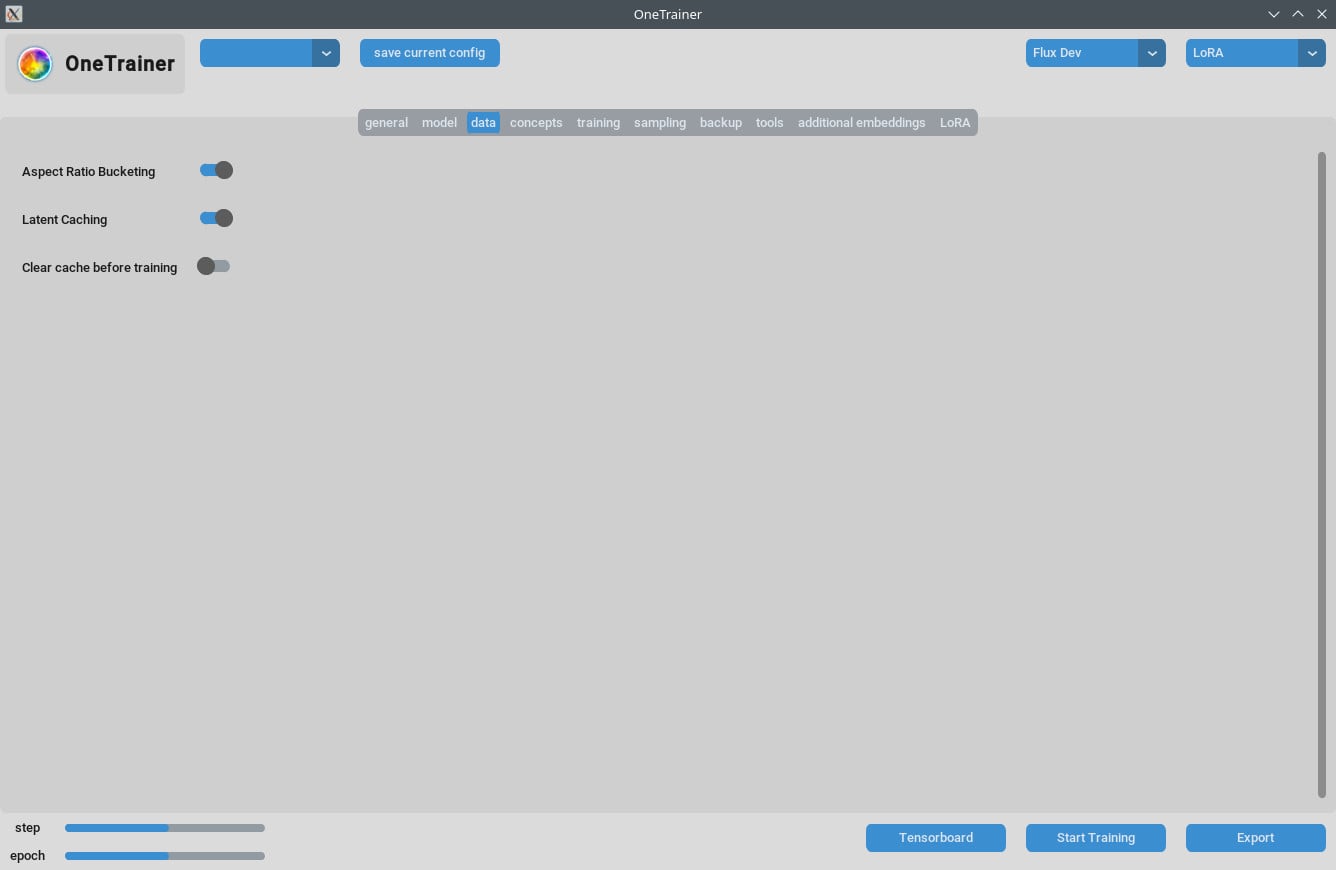

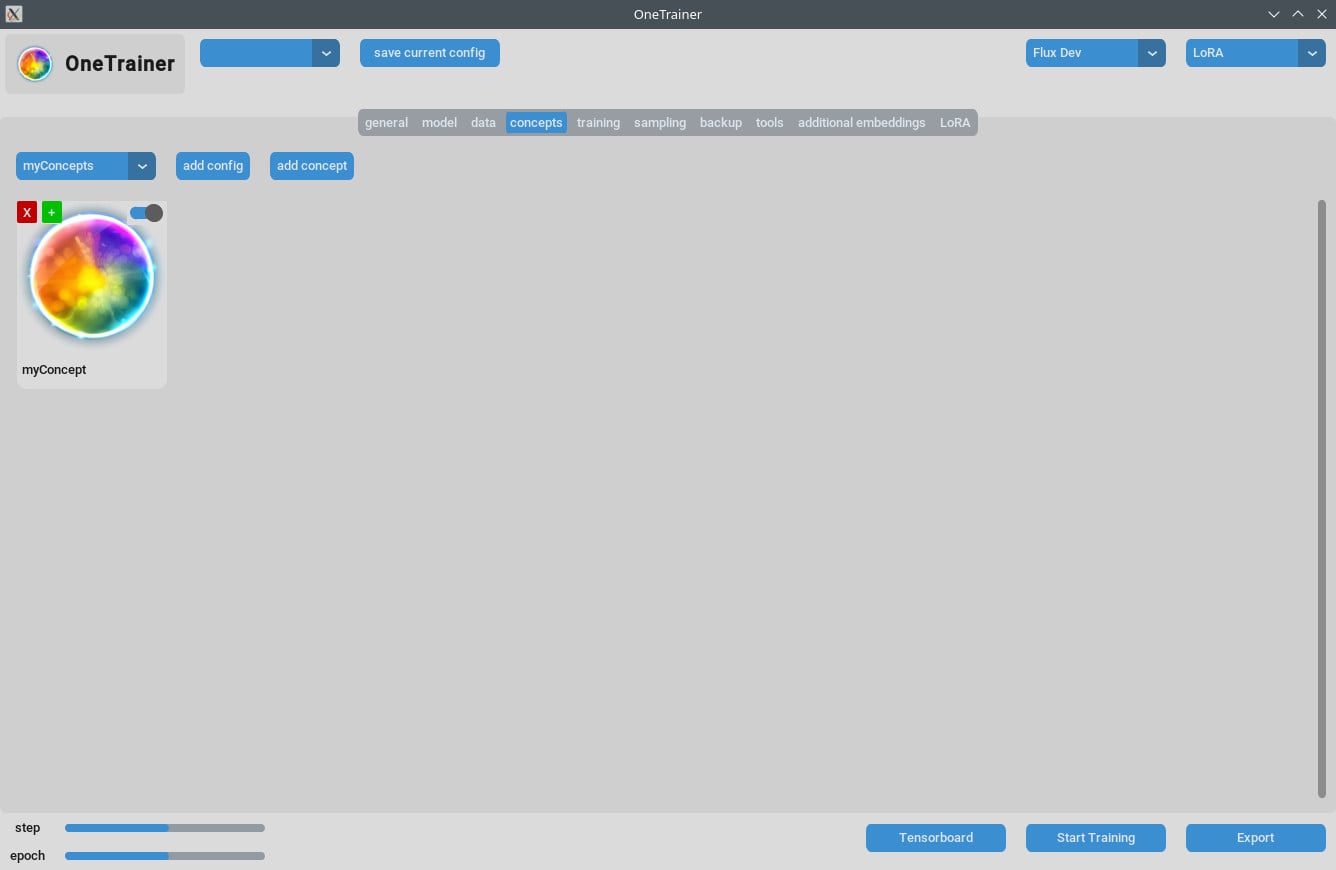

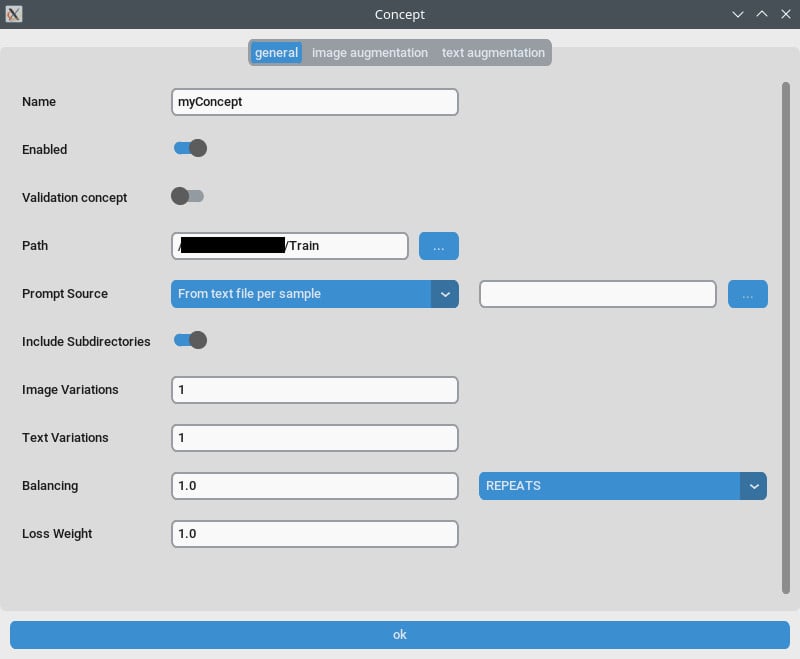

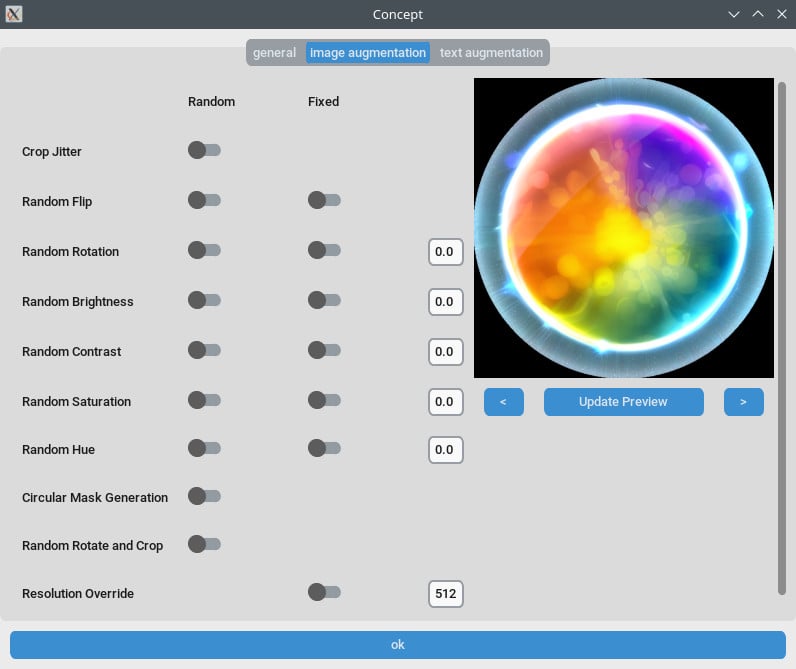

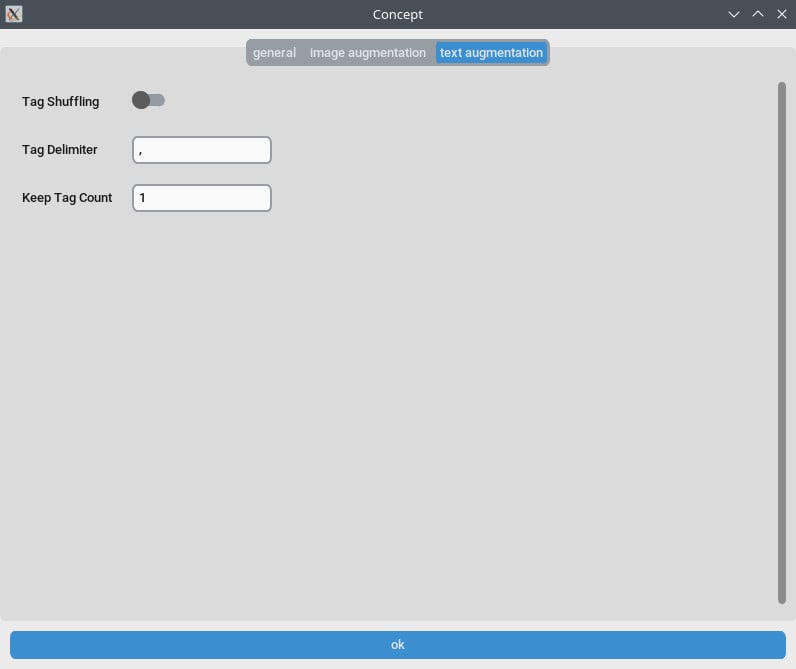

Pestaña de Concepto/Configuraciones Generales

- Repeticiones: Pon

Repeticionesen 1. Maneja el número de repeticiones a través delNúmero de Epochsen la pestaña de entrenamiento. - Fuente del Prompt: Usa "desde un archivo de texto único" si quieres una "palabra clave" en vez de subtítulos individuales por imagen. Indica el archivo de texto que contiene tu palabra o frase clave.

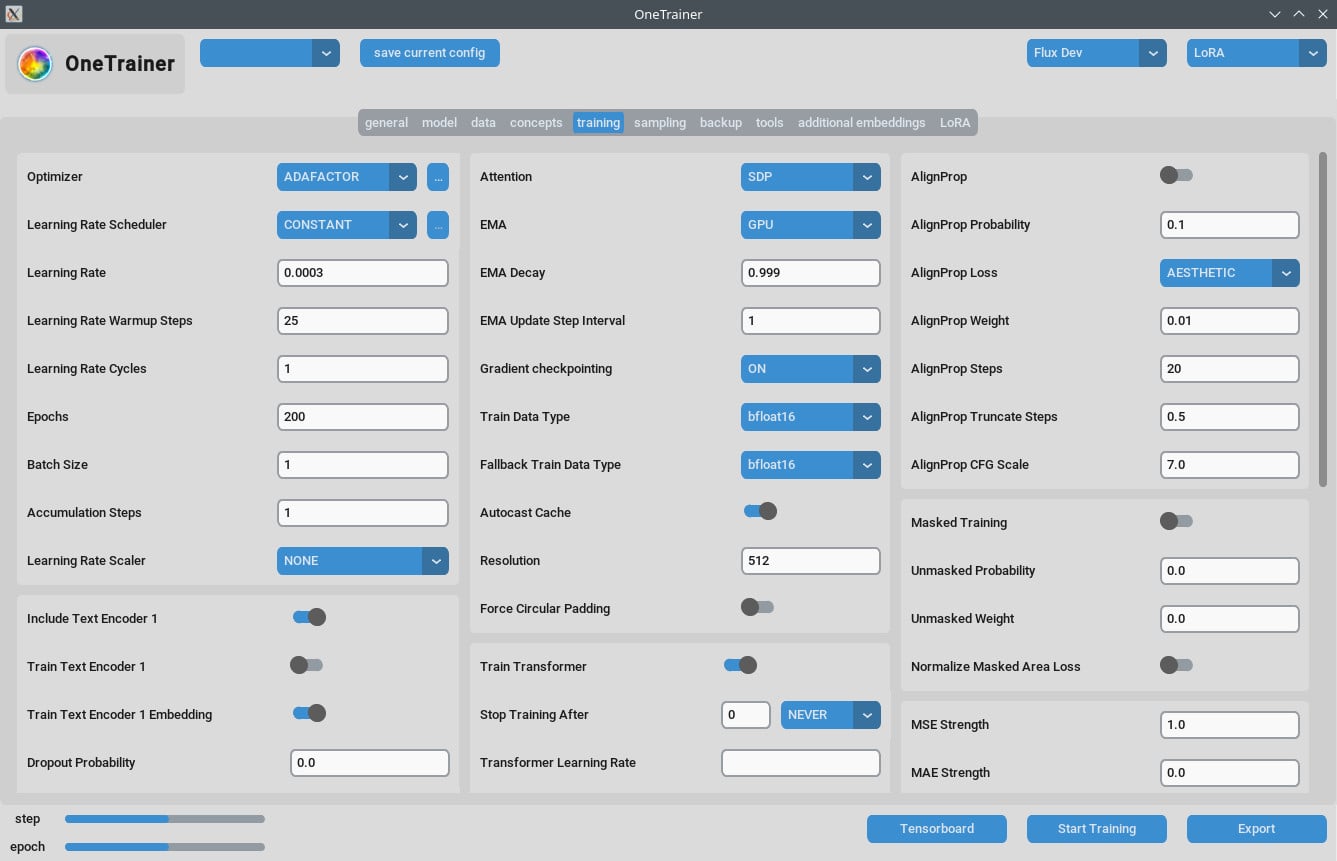

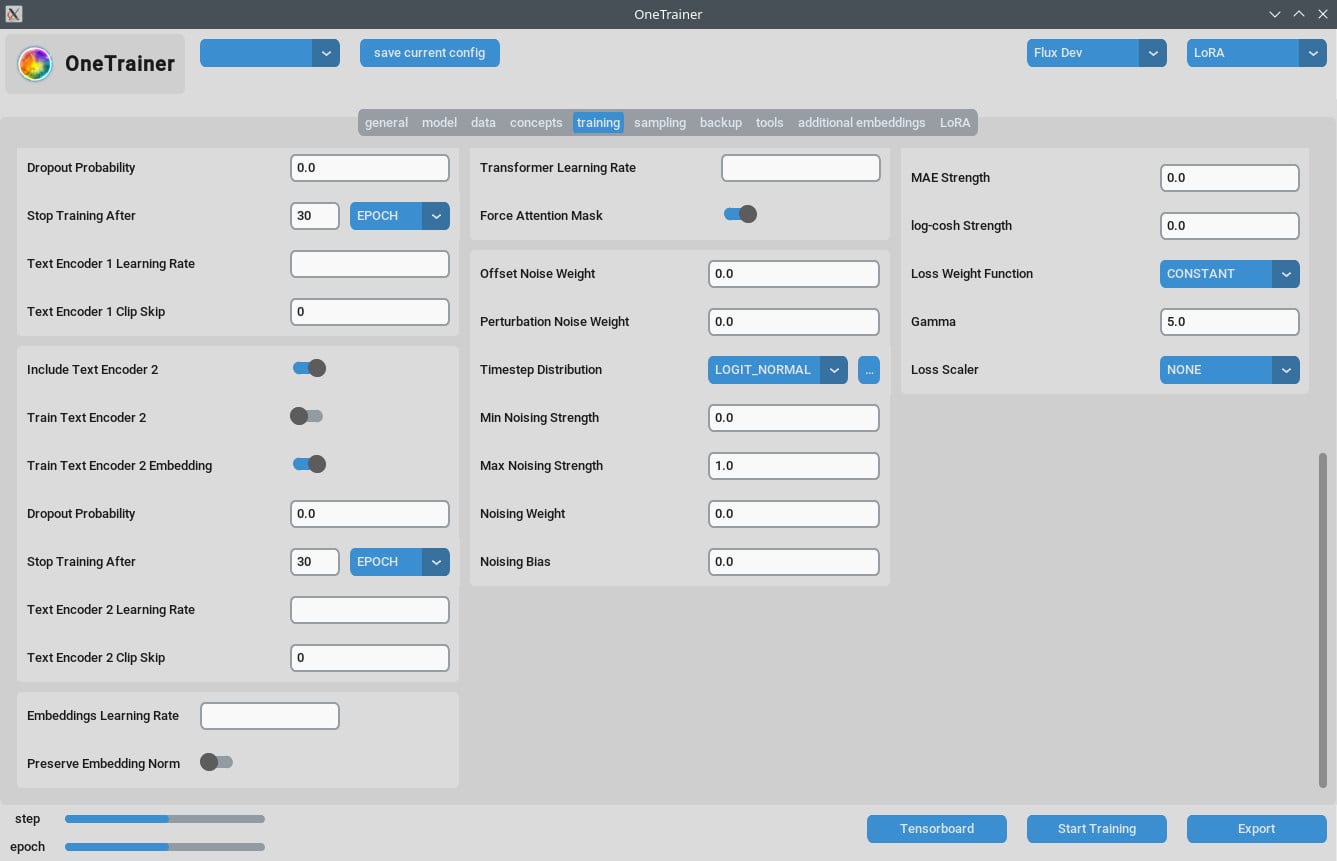

Pestaña de Entrenamiento

Configuraciones de Resolución

- Para Mejor Calidad:

- Establece la

Resoluciónen 768 o 1024 para salidas de mayor calidad.

- Establece la

- Configuraciones de EMA:

- EMA: Úsalo durante los entrenamientos de SDXL.

- EMA GPU: Para ahorrar VRAM, pon EMA de "GPU" a "APAGADO".

- Tasa de Aprendizaje:

- Un buen punto de partida podría ser 0.0003 o 0.0004. Ajusta según tus necesidades.

- Número de Epochs:

- Por lo general, 40 epochs dan buenos resultados. Ajusta según la complejidad de tu conjunto de datos.

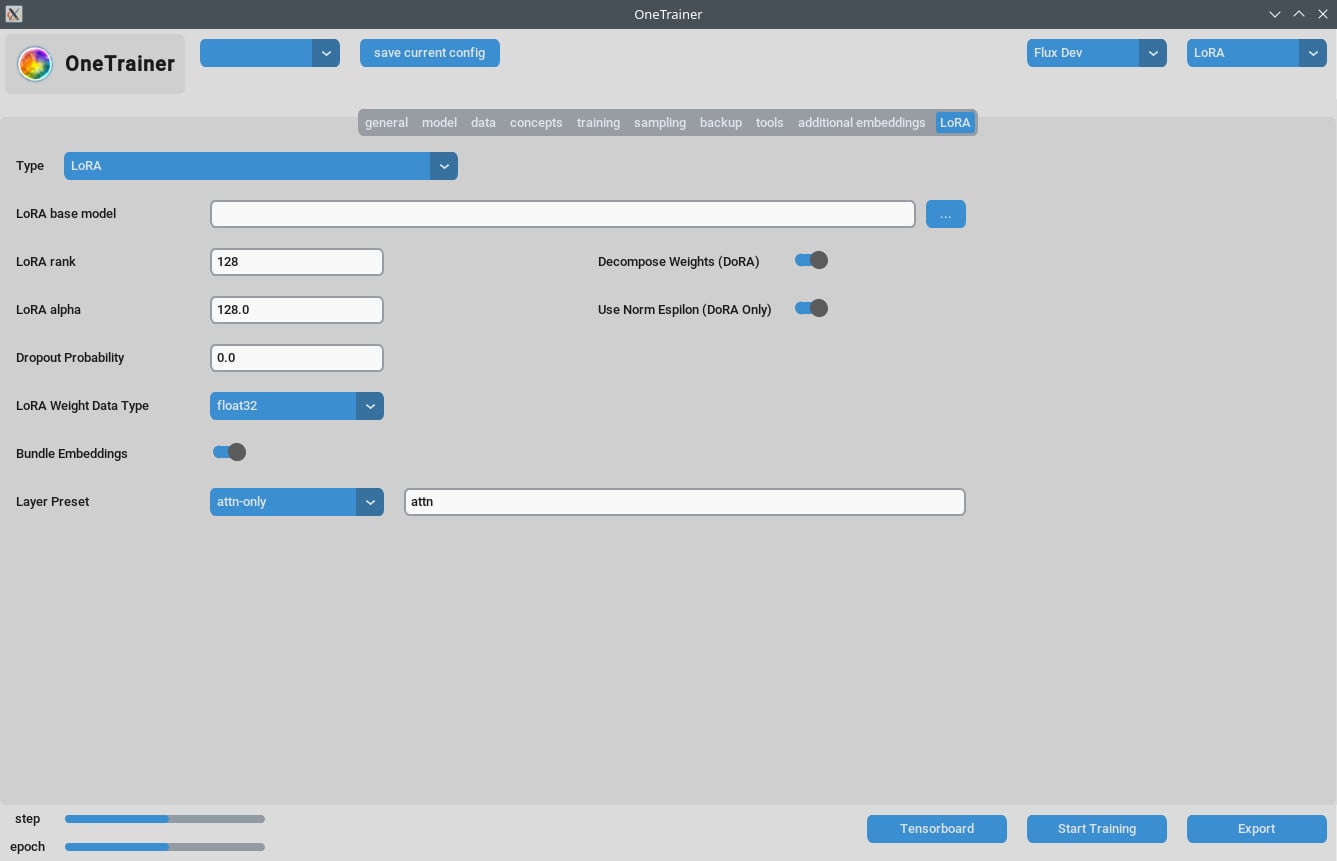

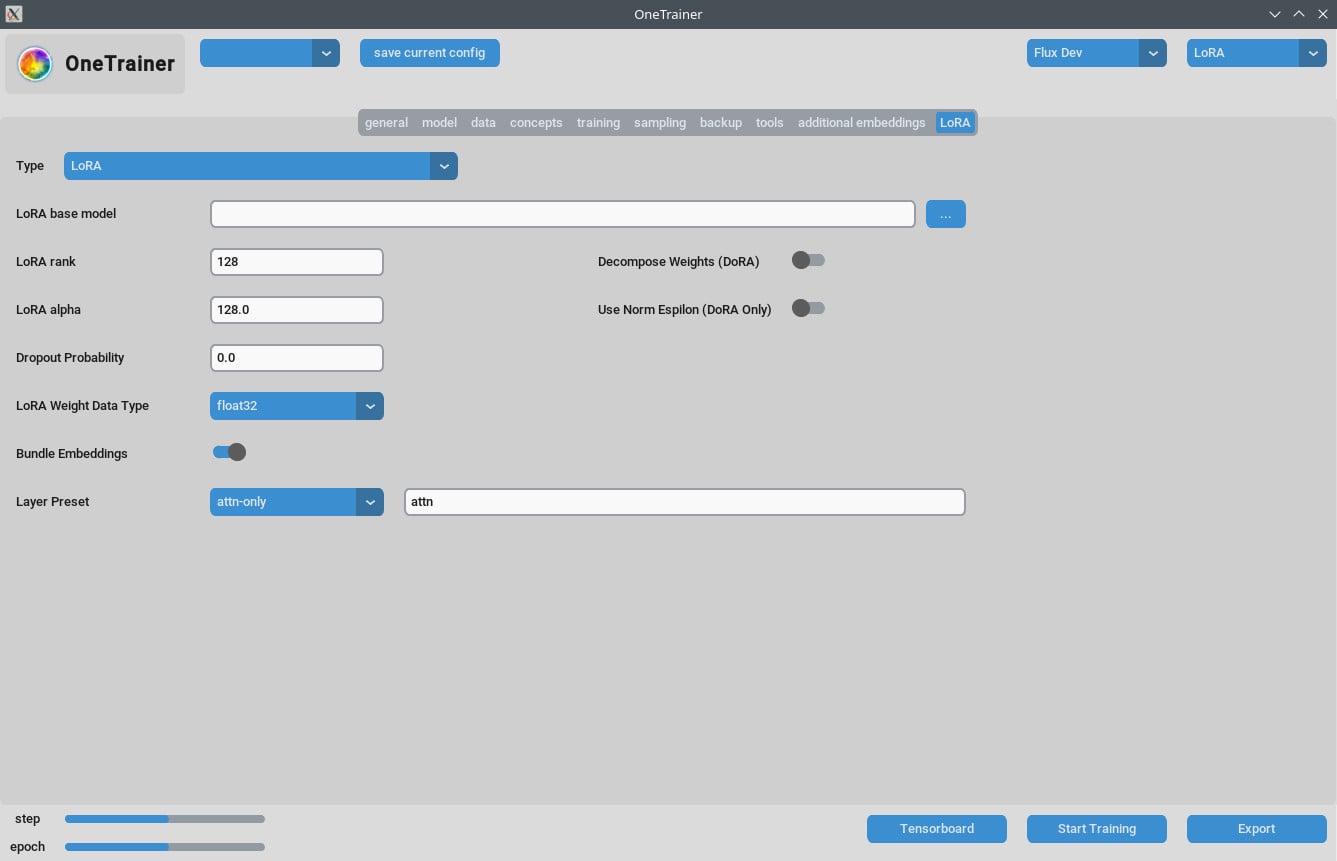

Pestaña de LoRA

- Rango y Alfa:

- Mantén estos valores iguales (por ejemplo, 64/64, 32/32) o ajusta tu tasa de aprendizaje según sea necesario.

- Modelos LoRA Resultantes:

- Asegúrate de que se apliquen las actualizaciones si usas versiones recientes de ComfyUI.

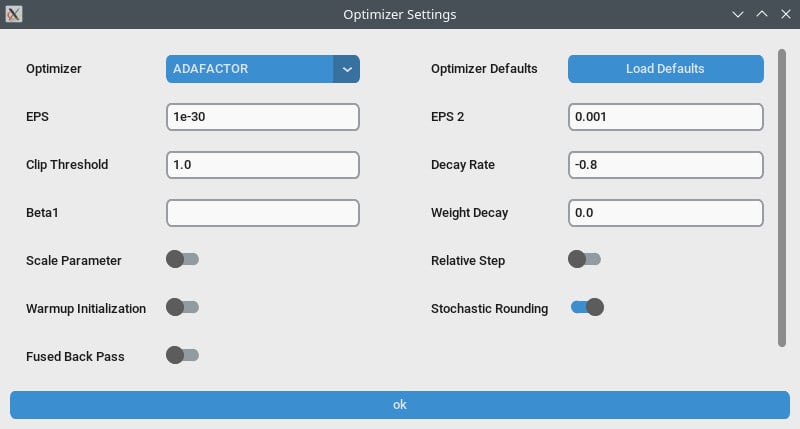

Optimización del Rendimiento

- Punto de Verificación de Gradientes:

- Prueba desactivarlo si sientes que va lento, especialmente si tu hardware soporta más VRAM.

- bf16 vs nfloat4:

- En la pestaña "modelo", cambia

Tipo de Dato Anterior Overridea bf16 para posiblemente aumentar la calidad. Esto afecta la VRAM y la velocidad.

- En la pestaña "modelo", cambia

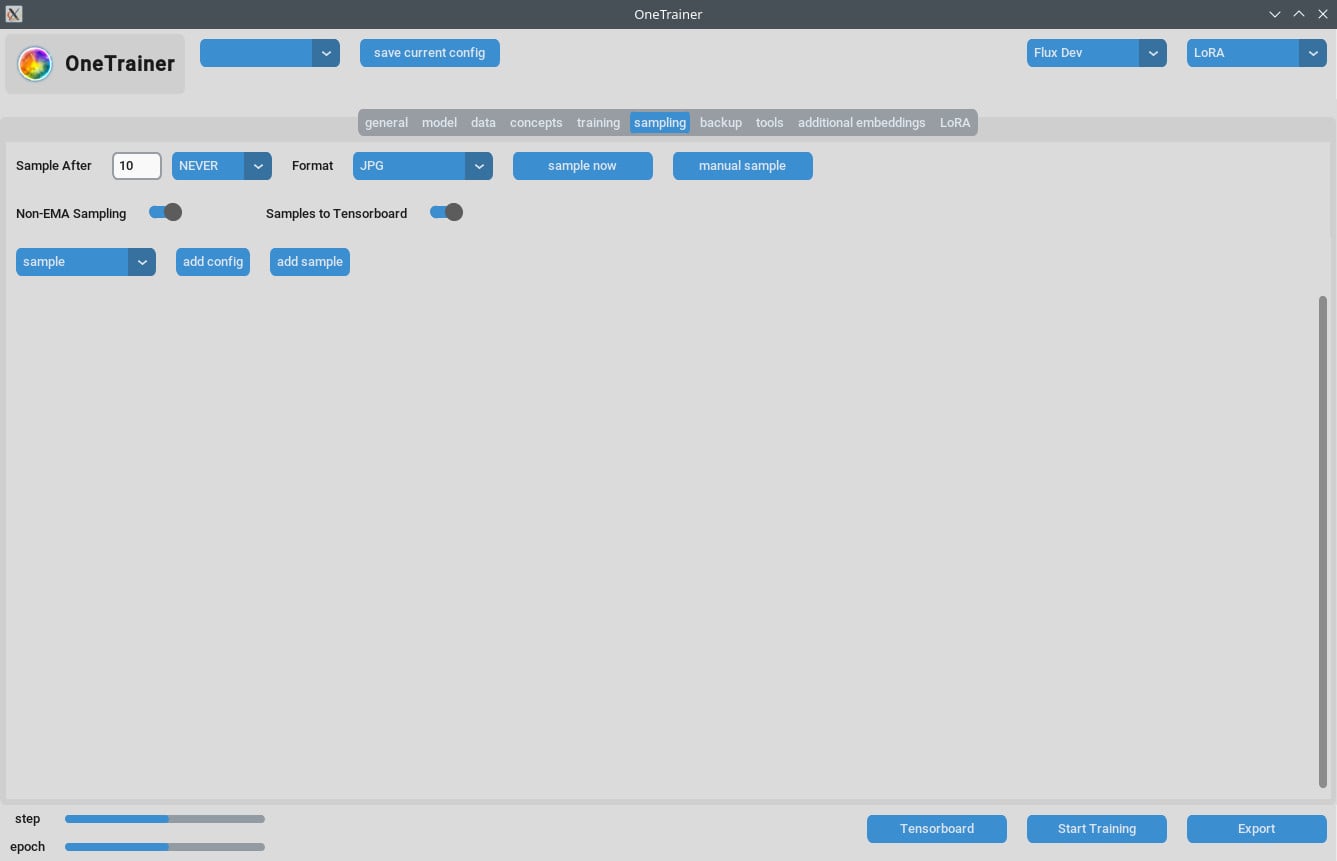

Manejo de Problemas de Muestreo

- Algunos usuarios han tenido errores de Memoria Insuficiente (OOM) durante el muestreo. Asegúrate de que tu GPU tenga suficiente VRAM.

- Mantén OneTrainer actualizado para incluir correcciones de errores y parches que aborden tales problemas.

Consejos para Entrenamiento Multi-Concepto

Limitaciones Actuales

- Entrenar varias personas con diferentes palabras clave en la misma sesión suele fallar.

- Objetos o situaciones diferentes (como zapatos de entrenamiento y autos específicos) funcionan mejor.

Mejores Prácticas

- Subtítulos Cortos:

- Usa subtítulos cortos y en lenguaje natural. Suelen funcionar bien en solo unos cientos de pasos.

- Apilando LoRAs:

- Apilar un LoRA de concepto y character da mejores resultados que el entrenamiento combinado.

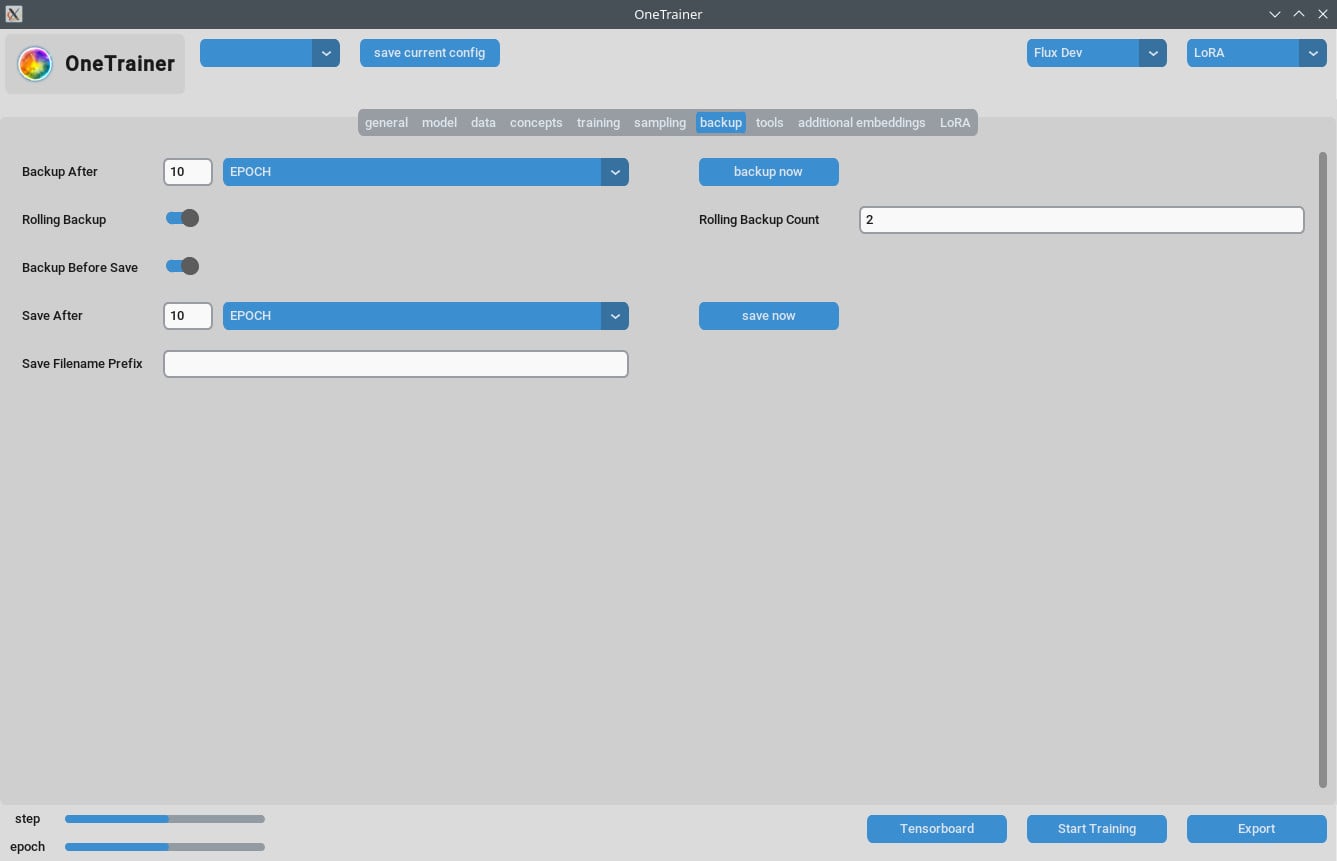

Gestión de Subtítulos y Datos

- Organiza tus datos de entrenamiento con cuidado. El número de epochs depende de la complejidad de tus datos.

- Subtítulos cortos y precisos pueden mejorar significativamente la eficiencia del entrenamiento.

Preguntas Frecuentes

P1: ¿Puedo usar OneTrainer para modelos que no sean Flux.1?

Sí, OneTrainer soporta SD 1.5, SDXL y más. Las configuraciones varían según el modelo.

P2: ¿OneTrainer usa automáticamente el nombre del concepto como palabra clave?

Sí, el nombre del concepto puede funcionar como una palabra clave. Asegúrate de que tenga sentido para tu proyecto.

P3: ¿Cómo puedo gestionar la VRAM durante el entrenamiento?

Establece Punto de Verificación de Gradientes a CPU_OFFLOAD. Esta configuración ayuda a reducir el uso de VRAM sin afectar mucho la velocidad.

P4: ¿Cuál es el impacto de usar NF4 vs. capas de precisión completa?

NF4 reduce el uso de VRAM pero puede disminuir ligeramente la calidad. Las capas de precisión completa mantienen la calidad pero requieren más VRAM.

P5: ¿Cómo reduzco el tamaño de mi modelo LoRA?

Puedes reducir los valores de Rango y Alfa o ajustar el tipo de dato de peso de LoRA a bfloat16. Esto reduce el tamaño pero puede afectar la calidad.

P6: ¿OneTrainer puede manejar entrenamiento multi-resolución?

Sí, OneTrainer soporta entrenamiento multi-resolución. Sigue las pautas en el wiki de OneTrainer para configurarlo.

P7: Mis imágenes aparecen en estática rosa al usar DoRA. ¿Qué debo hacer?

Revisa la configuración de tu capa de atención. Evita usar "completo" para las capas de atención, ya que podría estar causando el problema.

P8: ¿Cómo manejo múltiples sujetos en OneTrainer?

Usa entrenamiento equilibrado ajustando diferentes valores de repeticiones para cada sujeto. Organiza los datos con cuidado para que ambos reciban un entrenamiento equitativo.

P9: ¿Hay algo equivalente al 'modo dividido' en OneTrainer?

OneTrainer no tiene un 'modo dividido'. En cambio, usa configuraciones como CPU_OFFLOAD para Punto de Verificación de Gradientes y gestionar la VRAM de manera más efectiva.

P10: ¿Se pueden ajustar las configuraciones de OneTrainer para mejor calidad con más uso de VRAM?

Sí, aumenta la resolución y ajusta los tipos de datos y las configuraciones de punto de verificación de gradientes para mejorar la calidad.

Esta guía debe proporcionarte todos los pasos, configuraciones y consejos para usar OneTrainer con los modelos Flux AI de manera efectiva. ¡Feliz entrenamiento!